Google aconseja no usar canonical en las paginaciones

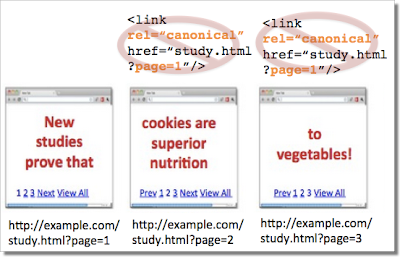

Publicado el 10 de abril del 2013, by Lino UruñuelaAyer Google publicó los 5 errores más comunes al usar el meta rel=canonical, de ellos el que más me llama la atención es "canonical en la primera página de una serie paginada" donde nos dicen

Yo siempre he dicho que no me gusta poner ese meta y que me gusta dejar las paginaciones rastreables e indexables (en muchos casos, que no en todos). En este artículo expongo una práctica para obtener distintos términos usando las paginaciones, aunque actualmente el ejemplo se ha quedado obsolote ya que no toco esa web desde hace más de 4 años....

Aquí dejo unos experimentos que he ido realizando para saber cómo trata Google el meta canonical

- Comprobando comportamiento de Google con meta canonical

- ¿Ha cambiado Google la forma en que trataba el meta canonical?

- Otra prueba para el meta canonical

- ¿Cómo afecatará poner meta canonical a si misma?

- ¿Cómo valora google una url con meta noindex y canonical?

Google ahora nos comenta lo que deberíamos hacer y supuestamente cómo lo trata. Está claro que una cosa es lo que dice y otra lo que hace, pero en este caso con este punto que comentan creo que es así y que hacerlo no será beneficioso para tu site.

Y es que hay muchísimas webs que usan este meta de esta manera. Se opina que el valor que tengan esas páginas con un meta canonical estará reforzando a la URL a la que apuntan, sumando así ésta el valor o parte del valor de todas las que la apunten con un canonical. Según los tests que menciono arriba el valor del los links que apuntaran a las paginaciones sí se otorgarían a la URL donde apuntan los canonicals, así que algo de valor parece que sí pasa.

Yo seguiré dejando las paginaciones indexables y rastreables, y si alguna no quiero que la rastree entonces la restringiré por medio del robots.txt porque además puede beneficiarte al dejar sitio a otras URLs.

Javier Lorente (@javier_lorente)hace Hace más de 11 años y 45 días

Totalmente de acuerdo