Validando masivamente términos potenciales para muchas KWs

Publicado el 19 de marzo del 2014 por Lino Uruñuela (Errioxa)Cuando manejamos un site muy grande en el que tenemos cientos o miles de categorías para clasificar el contenido, como podría ser un e-commerce, puede que haya categorías muy distintas entre si.

Por ejemplo una web podría vender desde clavos hasta tractores pasando por grúas o balones... lo que llamamos un popurrí de categorías, no todas las categorías comparten las mismas keywords potenciales para cada una.

Seguramente clavos al por mayor, o balones al por mayor son términos potenciales, que son buscados por determinado público y este público son clientes potenciales para nuestro negocio, pero podrían carecer de sentido aplicados a otra categoría como el caso de tractores, nadie busca tractores al por mayor....

¿O quizás sí se busque tractores al por mayor?

En muchos sites vemos cosas incoherentes como es el caso de tractores al por mayor ya que aplican los mismos términos a todas sus categorías o palabras clave y queda bastante mal ante el usuario a parte de que no generará ventas.

Para estos casos en el que tenemos cientos o miles de KWs que podrían tener sentido con unos términos, pero no con otros tenemos dos maneras de optimizarlo correctamente

- Repasando una a una estas categorías o KWs.

- Automatizando este proceso para filtrar los casos que no tienen sentido.

Aquí voy a exponer una manera automatizada de cómo podríamos hacerlo, tengo más, pero este es uno de los que mejores resultados me da casi siempre, y es usando el XML de Google suggest.

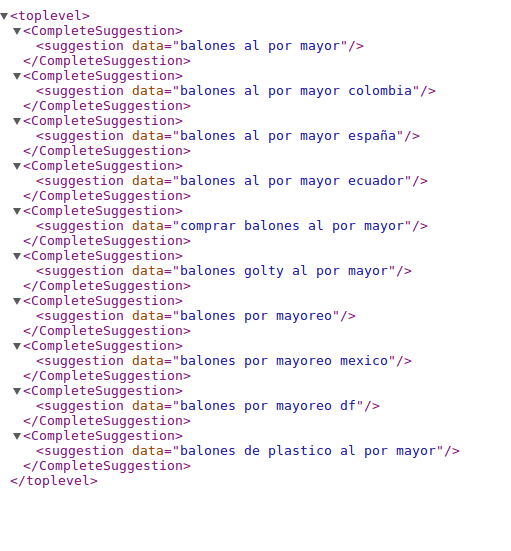

Cuando abrimos esta url vemos como Google nos devuelve unas sugerencias de términos que contienen esos términos.

Para ser más exactos creo nos devuelve los términos más cercanos entre sí dentro de su matriz de términos relacionados (es mi opinión) y son los resultados que observamos para algunas búsquedas en la parte inferior de las serps, no debmos confundir estos términos con los que salen en el suggest de la caja de búsqueda cuando vamos introduciendo texto, esto será otro post.

Vemos como para el ejemplo de balones al por mayor nos devuelve un xml con frases de búsqueda relacionadas, y vemos como el término que nosotros hemos buscado está presente.

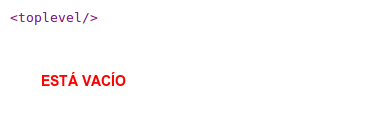

Con esto ya tenemos una primera manera de conseguir saber si un término como "al por mayor" es coherente con la categoría de "balones" y podemos crear un simple script que dadas unas KWs comprobara si tienen sentido con la KW "al por mayor" y hacer que nos reescriba los metas de nuestro site de manera mucho más eficaz que hacerlo a mano. Podemos comprobar como con "tractores al por mayor", el resultado devuelto está vacío, no existe, por lo tanto podríamos decir que no es común por lo que no lo incluiríamos en nuestra sección de tractores.

Antes en el resultado también te daba un número basado en el volumen de búsqueda, en un campo que se llamaba num_queries pero parece ser que lo han quitado. Si añadimos el parámetro &client=chrome podemos ver que descarga también datos númericos, pero siempre son los mismos para todas las KW así que no es relevante.

Estoy convencido que con algún otro parámetro podríamos conseguir otra vez este dato y así poder comparar dos KWs y saber por cuál de los dos es más buscado. Sigamos con el ejemplo de antes, ¿qué será más buscado "Comprar balones", "Venta de balones", o "balones online"? con el dato que ahora ha desaparecido podríamos haber realizado la comparación, pero ahora no nos lo dan y no podremos comparar el volumen de búsqueda entre ambos términos, de momento hasta que demos con el parámetro que nos ofrezca este número podremos validar si un término es coherente o potencialmente buscado para no tener cosas sin sentido en nuestro site.

También podemos optimizar más profundamente si tenemos varios términos posiblemente potenciales, por ejemplo, Venta de balones, Comprar balones, Comprar balones online, etc con este xml y si existe resultado para "venta de balones" y también para "Comprar balones" y para "Comprar balones online" podríamos alternarlos en las paginaciones como ya comentamos en su día.

Por supuesto estos datos que nos devuelve en base a una keyword nos pueden valer para muchas otras cosas, otra de ellas, de la que hablaré dentro de poco es como usarla para un KW research cuando ya se te hayan acabo las ideas.