El fichero Robots.txt para SEO

Escrito el miércoles 25 de Julio de 2007

Aquí mostramos los últimos artículos que tratan aspectos técnicos acerca del SEO y el robots.txt

Errores críticos originados por el robots.txt

- 2020-04-13 04:58:47

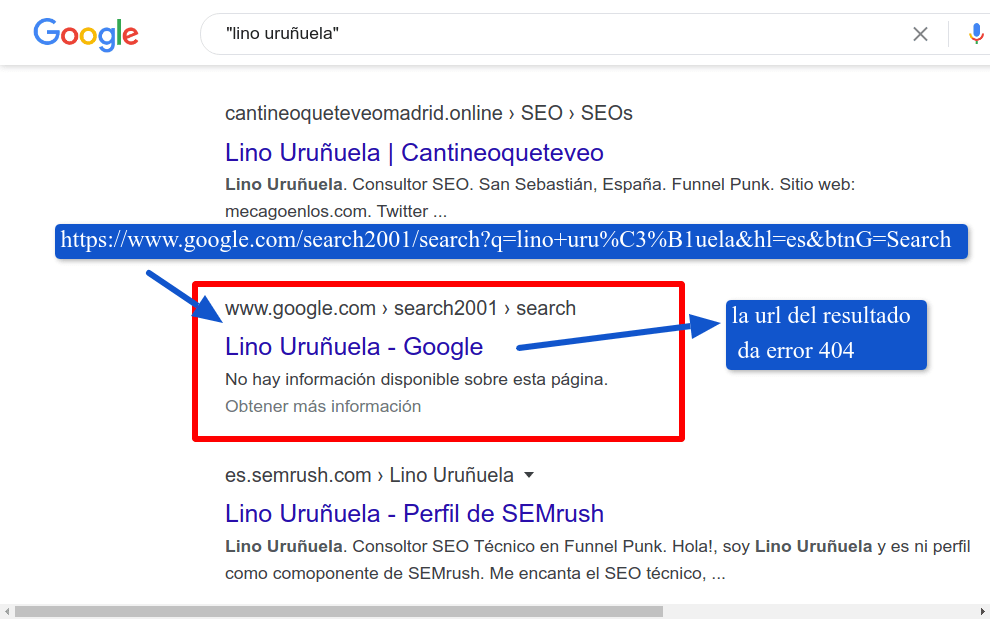

Publicado el 13 de abril del 2020 por Lino Uruñuela

Índice de contenido

¿Qué es el robots.txt?

¿Para qué sirve el robots.txt?

¿Comprueba Google el robots.txt para cada URL que rastrea?

Errores cr&

Seguir leyendo

Índice de contenido

¿Qué es el robots.txt?

¿Para qué sirve el robots.txt?

¿Comprueba Google el robots.txt para cada URL que rastrea?

Errores cr&

Seguir leyendo

Publicado el viernes 26 de febrero del 2016 por Lino Uruñuela

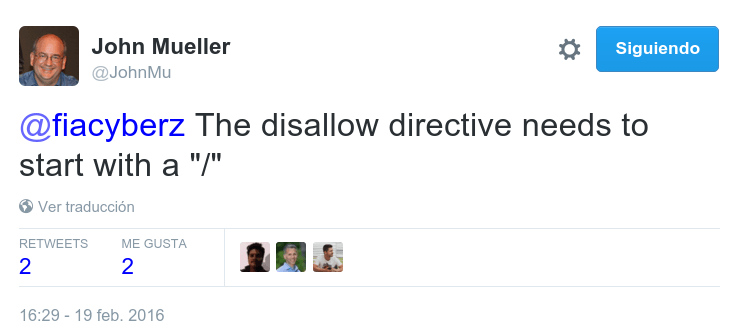

El otro día, mi socio Natzir me pasó el tweet de John Muller donde indicaba que la directiva Disallow del robots.txt debía comenzar siempre con un slash "/".

Seguir leyendo

El otro día, mi socio Natzir me pasó el tweet de John Muller donde indicaba que la directiva Disallow del robots.txt debía comenzar siempre con un slash "/".

Seguir leyendo

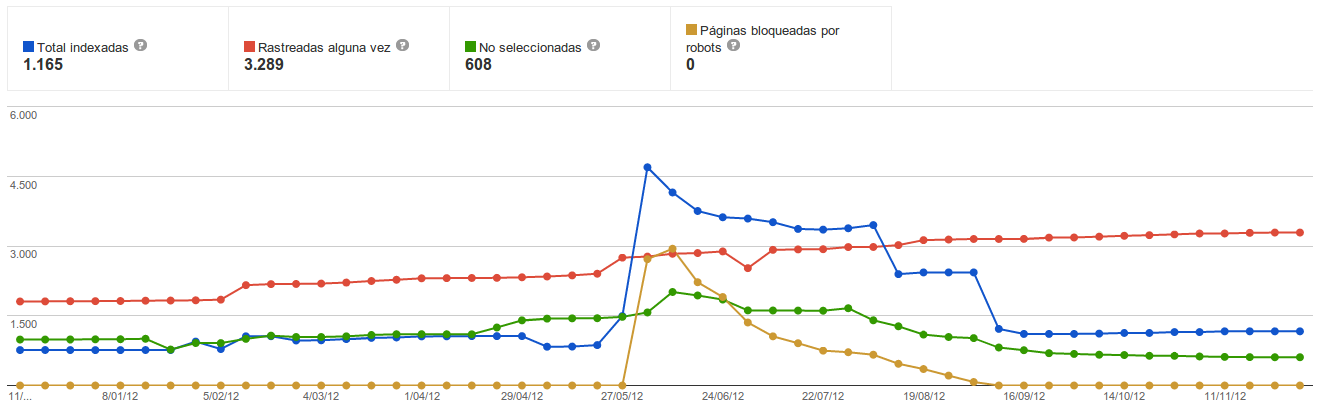

Publicado el 3 de diciembre del 2012, by Lino Uruñuela

Llevo unos cuantos meses observando un comportamiento algo contradictorio al restringir URLs desde el robots.txt. Supuestamente en el robots.txt puedes re

Seguir leyendo

Llevo unos cuantos meses observando un comportamiento algo contradictorio al restringir URLs desde el robots.txt. Supuestamente en el robots.txt puedes re

Seguir leyendo

PR sculpting con JavaScript y Robots.txt

- Domingo 28 de Febrero del 2010

Publicado el 28 de febrero del 2010 Ya vimos como hacer PR sculpting usando JavaScript, así, independientemente de cómo Google quiera valorar los enlaces nofollow (a veces nos dice que valen para pr sculpting y otras nos dice que no) nos aseguramos que el peso de una url lo tr

Seguir leyendoOtra forma de hacer PageRank sculpting

- Jueves 04 de Junio del 2009

Publicado el 4 de junio del 2009 Se está montando un pequeño revuelo en el mundo SEO a costa de unas declaraciones de Matt Cutts en el SMX advance (no, el de Madrid no) acerca de la nueva manera en que Google trata los enlaces con nofollow. Antes Hasta ahora si tenías 10

Seguir leyendo