¿Se está transformando Google en un motor de recomendación?

Publicado por Lino Uruñuela el 2025-07-01

Motores de búsqueda

No voy a explicar a fondo qué es un motor de búsqueda, cualquiera que lea este blog debería tener más o menos claro ese concepto. Pero quizás sí sea bueno recordar que un motor de búsqueda intenta ofrecer la información más relevante para la búsqueda del usuario... con todo lo que eso conlleva.

Uno de los puntos más difíciles para los buscadores ha sido el interpretar la intención del usuario cuando realiza una búsqueda, es algo que podría parecer sencillo pero no lo es en absoluto.

Con la llegada de Bert, Google dio un gran paso adelante a la hora de interpretar la consulta de búsqueda de los usuarios, ese fue un cambio muy importante, y aunque muchas veces pensamos en cómo Bert podría influir a la hora de valorar el contenido de nuestro site, realmente, lo más relevante fue que Bert permitía conocer mucho mejor la intención que un usuario tenía al realizar una búsqueda.

De esta forma podía seleccionar resultados que se ajustasen a esa intención, por ejemplo si la intención era comprar algo, mostraría resultados más cercanos a tiendas online o resultados que diesen una buena reseña sobre el producto.

Motores de recomendación

Los motores de recomendación (Instagram, Google Discover, TikTok, YouTube, etc.) son sistemas que intentan predecir cuál es la probabilidad de que un usuario realice determinadas acciones si se le presenta determinado contenido, por ejemplo, en Instagram te mostrará aquello que tenga más posibilidades de que interactúes con ello, basándose, entre otras cosas, en la actividad anterior en la plataforma.

Cada vez que interactúas con piezas de contenido se va generando un perfil de qué temática de contenido te gusta en qué momento, qué le ha gustado a usuarios que tienen perfiles similares al tuyo.

Cuando digo perfiles debemos entender cómo qué usuarios tienen una actividad en la que interactúan con contenidos con las mismas características que el contenido con el que tú interactúas.

¿Cómo funciona YouTube?

Pero entender en profundidad estos algoritmos no es nada sencillo, como muestra podemos ver este vídeo dónde muestran cómo en YouTube, la recomendación no es una función más sino que es el corazón de la plataforma.

La gran mayoría del tiempo de visualización de los usuarios es generado por su sistema de recomendación. Divyansh, gerente de producto de YouTube, dice que el uso de los LLMs en YouTube es una implementación "más grande y subestimada que su uso en la búsqueda", precisamente porque su impacto es "invisible" pero masivo.

Un problema típico y que YouTube también sufrió, fue el arranque en frío (o "cold-start"), ¿cómo Youtube puede recomendar un vídeo que acaba de ser subido si el sistema no sabe nada de él?.

A pesar de que Google / Youtube tienen uno de los modelos de lenguaje más avanzados, los IDs de los vídeos "tradicionales", basados en un hash (una simple cadena de letras y números), no le dicen nada sobre el contenido del vídeo al LLM, en este caso Gemini.

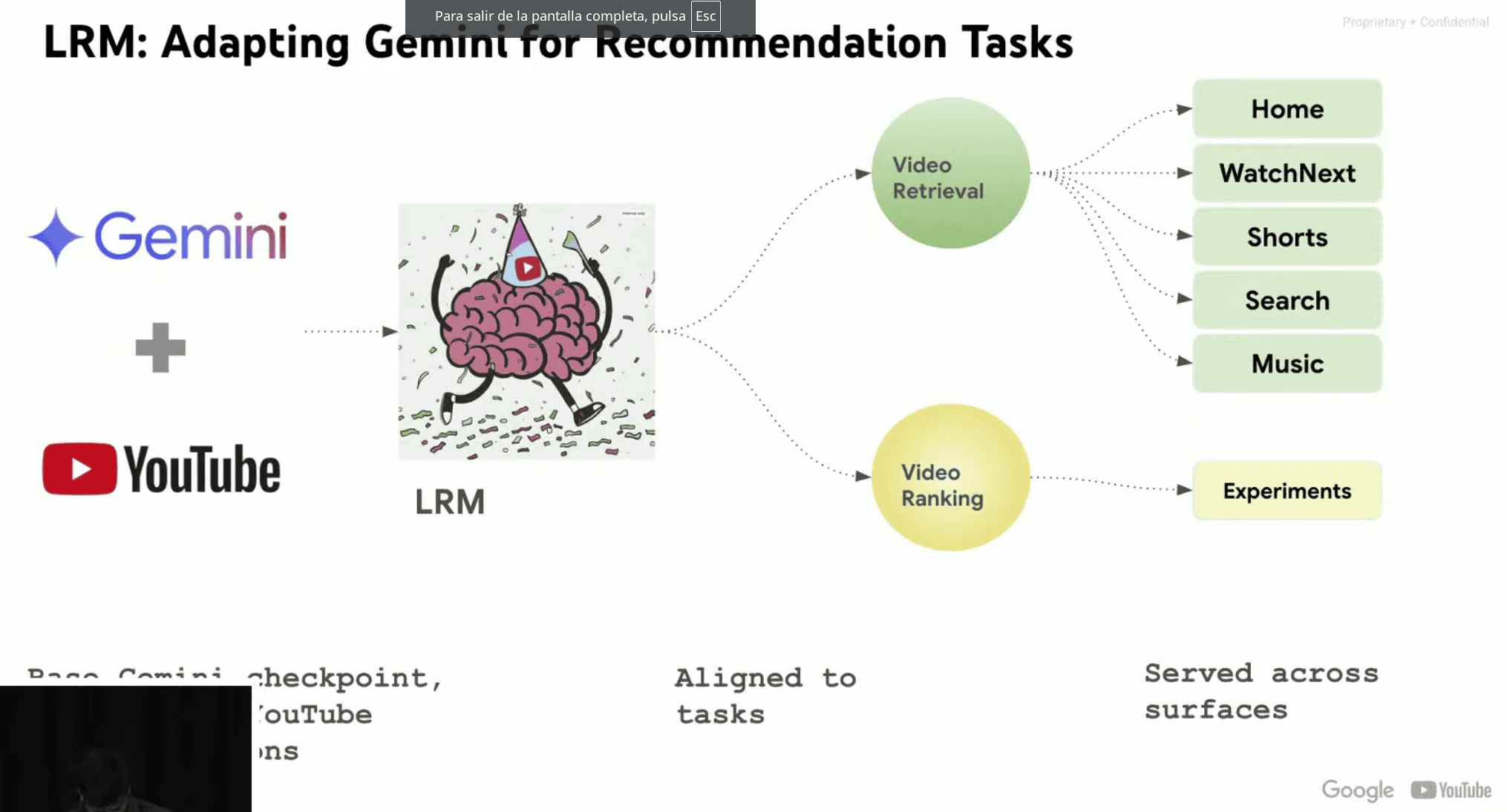

Para el motor de recomendación que vertebra Youtube, un vídeo de un gatito y uno sobre física cuántica eran, en esencia, dos códigos aleatorios. Hace dos años lo repensaron desde cero usando Gemini como base. El resultado es el LRM (Large Recommender Model).

ID semánticos

Para que un LLM entienda los vídeos, primero necesita un "vocabulario" de vídeos y YouTube creó Semantic ID (SID), que no solo es un identificador sino también una representación semántica del contenido del vídeo y de sus características.

¿Cómo genera YouTube el Semantic ID?

-

Extracción Multimodal: Además de usar el título y la descripción del vídeo también usan la transcripción completa del audio, las características del sonido e incluso fotogramas clave del vídeo. Para seleccionar estos fotogramas clave extraen los tiempos en los que hay mayor interacción de los usuarios.

-

Creación del Embedding: Toda esta información multimodal se combina y se convierte a embeddings multidimensionales.

-

Cuantificación y Tokenización: Este embedding se "cuantifica", es decir, se comprime y se le asigna un token único: la SID.

Al realizar esto con miles de millones de vídeos surge un "nuevo lenguaje de vídeos de YouTube". En este lenguaje, el SID de un vídeo no es aleatorio. Por ejemplo, dos vídeos de voleibol podrían compartir los primeros tokens de su SID (que representan "deportes" -> "voleibol"), pero tendrían un identificador único al final.

Con este método un vídeo nuevo ya no entra al sistema siendo un desconocido. Entra con un SID que le dice al recomendador: "Hola, soy un vídeo sobre la historia del rock de los 80, similar a estos otros vídeos" y esto soluciona el problema pasando de un arranque en frío a un "arranque en caliente en un espacio semánticamente significativo".

YouTube habla "inglés" y "YouTube"

El "lenguaje de YouTube" es el lenguaje de los SIDs, pero necesitaban un "traductor" al lenguaje humano. Este traductor es un modelo Gemini adaptado y reentrenado LRM (Large Recommender Model) para ser "bilingüe".

El entrenamiento consta de dos tareas principales:

-

Vincular Texto y SID: Le dan al modelo el título de un vídeo y le piden que genere su SID, o viceversa. Así aprende la conexión directa entre el lenguaje humano (texto) y el lenguaje de YouTube (SIDs).

-

Comprender Secuencias de Visualización: Le muestran miles de millones de secuencias de vídeos que los usuarios han visto (ej: A -> B -> C -> D). Luego, ocultan un vídeo (ej: A -> B -> [MÁSCARA] -> D) y le piden al modelo que prediga cuál es el vídeo que falta. Es algo muy parecido a cómo se entrenan los LLMs.

El LRM no solo memoriza, sino que aprende a razonar. Puede ver un historial de visualización y, basándose solo en el SID de un nuevo vídeo, inferir que "este vídeo es interesante para los usuarios a los que les gusta la tecnología porque trata sobre IA".

Recuperación Generativa Personalizada

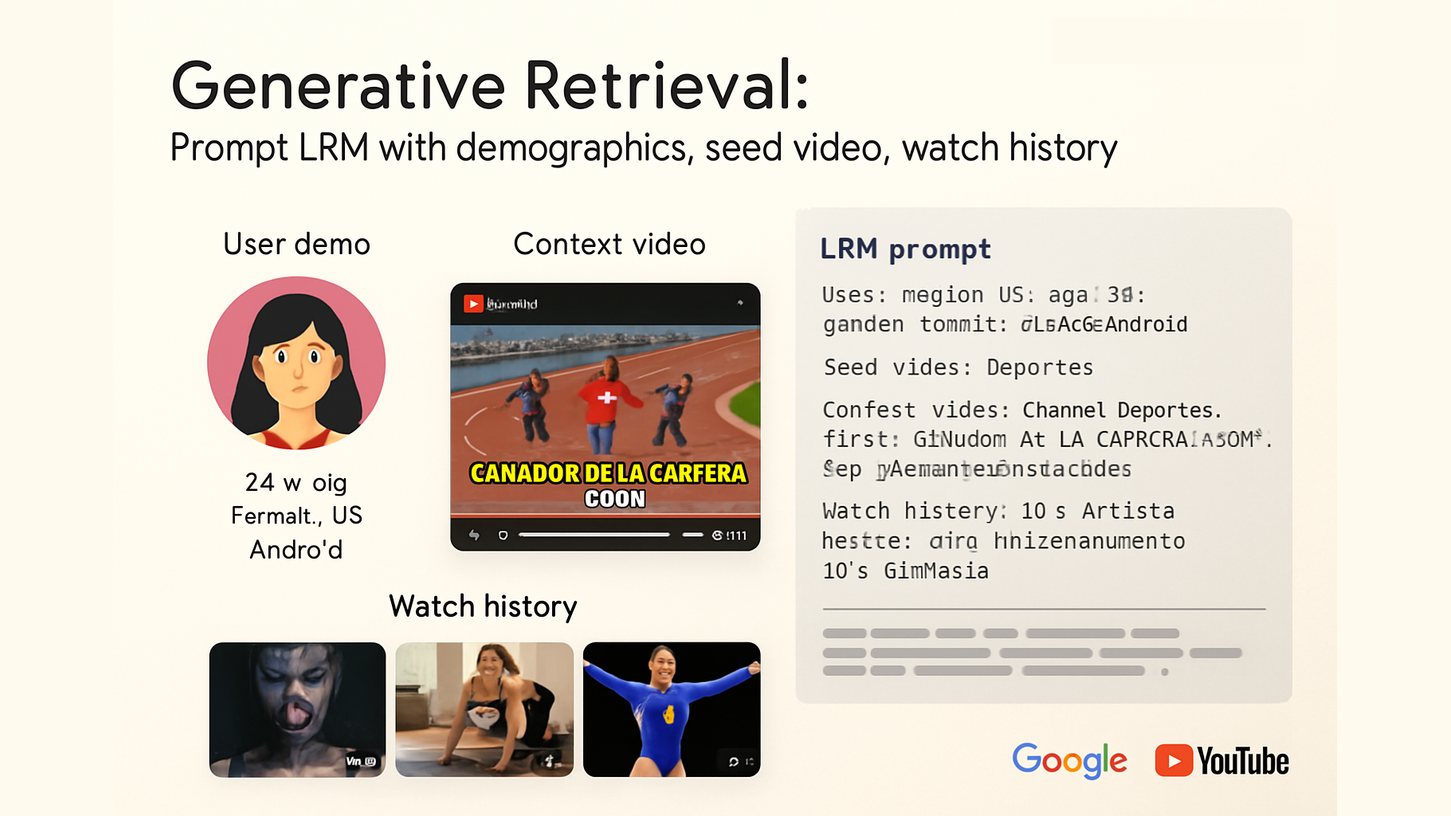

Una de las primeras aplicaciones en producción es la recuperación generativa. Así funciona para los usuarios:

-

Construyen un prompt personalizado en tiempo real. Este prompt incluye la información demográfica del usuario (edad, género, ubicación), el vídeo que está viendo ahora mismo y el historial reciente del usuario (los últimos 50 vídeos que ha visto y cómo interactúa con ellos).

-

Le pasan este prompt al LRM.

-

El modelo, en lugar de generar texto, decodifica su respuesta como una lista de SIDs: las recomendaciones de vídeo que considera perfectas para ese usuario en concreto en ese preciso momento.

De esta manera consigue mostrar recomendaciones muy precisas y personalizadas. Por ejemplo, para un usuario que veía un vídeo de los mejores momentos de los Juegos Olímpicos, el LRM fue capaz de encontrar y recomendar carreras femeninas relacionadas que los sistemas anteriores no hubieran mostrado.

¿Está transformándose la búsqueda de Google en un Motor de Recomendación?

Y esta es mi corazonada... ya desde hace años había gente (como Luisma, Chuiso y otros "locos") que ya venían diciendo cómo los clics afectaban a los rankings, aunque pocos les creímos, como yo mismo, eso sí, cuando me lo demostraron me lo creí y lo asumí.

También este año hemos visto cómo el caso antimonopolio de Google ha destapado que sí se utilizan los datos de clics (y otras interacciones) en las SERPs de Google y que eran usados de una u otra manera para evaluar y optimizar los resultados de búsqueda. Ahora anuncian oficialmente más personalización de los resultados...

Todo esto junto al nuevo AI Mode que ofrecerá, en muchas ocasiones, la respuesta completa a la consulta del usuario, y sabiendo lo importante que son para los grandes LLMs como ChatGPT o Gemini la retroalimentación por parte de los usuarios... me hace pensar que la búsqueda de Google se está transformando en un motor de recomendación.

Os recomiendo ver el vídeo, concretamente la parte en la que explica cómo funciona YouTube.