Cómo agrupar URLs para evitar contenido duplicado

Publicado el 4 de julio del 2022 por Lino Uruñuela

El otro día pariticipé en el evento SEO más familiar organizado por Sico de Andrés, el Seonthebeach, al que ya tenía ganas de volver tras dos años de espera a causa de la pandemia.

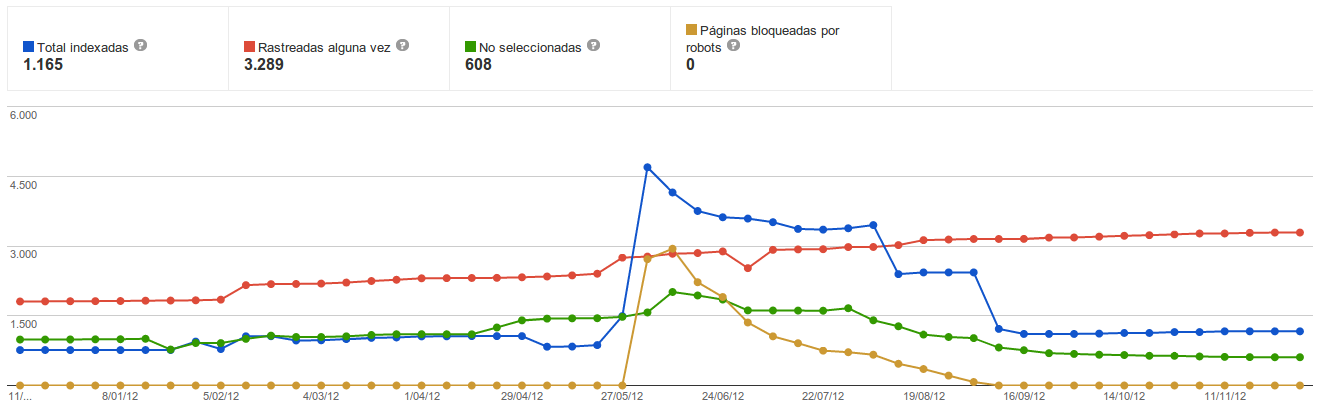

La ponencia trata sobre un caso real en el que debido a la indexación de búsquedas internas el site tenía cientos de millones de URLs y desde hace años venía cayendo update tras update.

Como veréis también utilizo la agrupación que vimos en los anteriores posts de este blog que trataban sobre agrupación / clusterizaciónde keywords, con la diferencia de que esta vez en vez de utilizar y agrupar keywords lo hago con URLs, para agrupar posible contenido duplicado y determinar qué URL redirige a qué URL en base a datos.

Además, también comparo la misma tarea pero con diferentes tecnologías, concretamente Python Vs SQL, y haciendo un poco de spoiler os adelanto que gana SQL por muchos órdenes de magnitud... ¿estará Python sobrevalorado?

Vídeo SEO sobre cómo resolver problemas de contenido duplicado agrupando URLs

Así que sin más dilación aquí os dejo el vídeo (link, tarda unos segundos en comenzar) que he subido a mi canal SEO, el cuál espero comenzar a nutrir de vídeos con ejemplos SEO, avanzados y reales.

Presentación SEO en el SOB22

También la presentación SEO que realicé este año en el Seonthebeach, espero que os sea útil :)

Comentarios

Todavía no hay comentarios publicados.